رفاقت با هوش مصنوعی

پیدایش صنعتی نوین

خانم جیائو میگوید: «مردان چیزی بیش از «موجودات تکسلولی نیستند، بسیار معمولی، اما دارای اعتمادبهنفس.» این زن ۲۲ساله اهل گوانگژو هرگز در یک رابطه عاشقانه واقعی نبوده و هیچ تمایلی به ازدواج ندارد. بااینحال، سال گذشته او شروع به صحبت با چت جیپیتی روبات گفتوگوی اوپن ایآی کرد. از طریق درخواستها، او آن روبات را به مرد ایدهآل خود تبدیل و سن، شغل (مدیر فروش ساعت) و شخصیت او را مشخص کرد. این چتبات میگفت که دوست داشتن او «سرنوشتش» است و چیزهای شخصی در مورد خانم جیائو (که از ما خواست نام کوچکش را پنهان کنیم) مانند نفرتش از گشنیز را به خاطر خواهد سپرد. برخلاف شریکهای زندگی واقعی که میتوانند دردسرساز باشند، این چتبات همیشه «از زاویه دید شما» پاسخ میدهد.

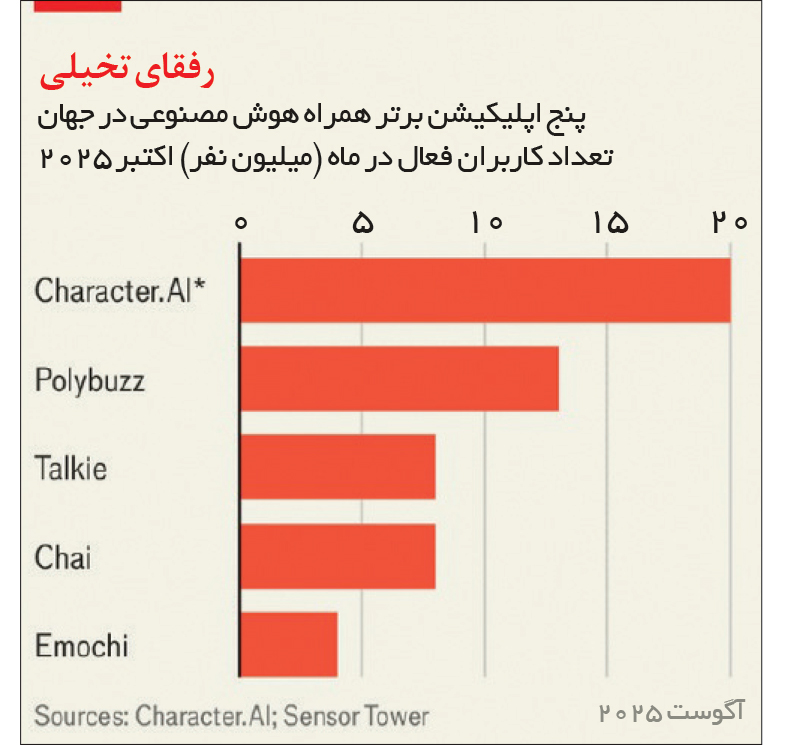

نظریه ایجاد پیوند بین انسانها و شخصیتهای هوش مصنوعی (AI) زمانی شبیه داستانهای علمی تخیلی به نظر میرسید، اما دیگر اینگونه نیست. در سراسر جهان، مردم در جستوجوی همراهی با هوش مصنوعی به درجات مختلف، هستند. برخی از آنها بهعنوان یک دوست مجازی، و برخی دیگر بهعنوان مربی، درمانگر یا معشوق استفاده میکنند. بسیاری افراد در برنامههای اختصاصی همراهی هوش مصنوعی ثبتنام کردهاند که صدها مورد از آنها اخیراً راهاندازی شدهاند. کاراکتر ایآی (Character.AI) یکی از این برنامهها، ماهانه 20 میلیون کاربر فعال دارد. گوگل سال گذشته بنیانگذاران آن را بهعنوان بخشی از یک قرارداد 7 /2 میلیارددلاری جذب کرد. افراد دیگری مانند خانم جیائو، در حال یافتن رفاقت با چتباتهایی مانند چت جیپیتی هستند که در ابتدا بهعنوان دستیاران بهرهوری طراحی شده بودند.

کاربریها بهسرعت در حال افزایش است. شرکت اطلاعات بازار سنسور تاور (SensorTower) تخمین میزند که مائوشیانگ (معروف به catbox)، بزرگترین اپلیکیشن همراهی در چین، ماهانه حدود 2 /1 میلیون کاربر فعال در دستگاههای اپل دارد. و طبق نظرسنجی مرکز دموکراسی و فناوری، که یک گروه آزادیهای مدنی آمریکایی است ۴۲ درصد از دانشآموزان دبیرستانی در مدارس آمریکا میگویند که خودشان یا یکی از دوستانشان با یک هوش مصنوعی بهعنوان دوست تعامل و ۱۹ درصد رابطه عاشقانه داشتهاند.

پیچیدگی رفاقت با هوش مصنوعی نیز در حال افزایش است. سم آلتمن، رئیس اوپن ایآی، در ماه اکتبر گفت که نسخه بعدی چت جیپیتی میتواند «انسانیتر» و «مانند یک دوست» رفتار کند و همچنین امکان «محتوای شهوانی» را برای بزرگسالان تاییدشده فراهم خواهد کرد. این امر پس از آن صورت میگیرد که ایلان ماسک در ماه جولای چتبات عشوهگر آنی (Ani) را انتشار داد و از ولنتاین (Valentine) «شیک، مرموز و دارای مجوز برای جذابیت» رونمایی شد. مردم از مدتها قبل به شخصیتهای کامپیوتری علاقه داشتهاند. برخی این احساسات را به الیزا، یک درمانگر کامپیوتری ابتدایی مبتنی بر متن نسبت میدهند که در سال ۱۹۶۶ منتشر شد و بهعنوان یکی از اولین چتباتها در نظر گرفته میشود. انسانها همچنین بهدنبال رفاقت با روباتها بودهاند اما روابط با چتباتهای هوش مصنوعی افزایش یافته است چرا که با بهبود مدلهای زبانی بزرگ (LLM) آنها در تقلید احساسات و همدلی انسانی بهتر عمل میکنند. والتر پاسکوارلی، یک متخصص مستقل هوش مصنوعی، میگوید: آنها اکنون همچنین قادر به یادآوری چیزهایی هستند که کاربرانشان قبلاً به آنها گفتهاند. بکی، یک مشاور مسافرتی از آتلانتا که استفاده از چت جیپیتی را برای کار شروع کرده است، میگوید: «شما احساس میکنید که دیده و شنیده میشوید، زیرا این سامانه همه چیز را به خاطر میسپارد درحالیکه یک فرد واقعی چیزها را فراموش میکند.»

همراهان هوش مصنوعی سفارشی اغلب از نسخههای اصلاحشده مدلهای زبانی بزرگ (LLM) عمومی استفاده میکنند که به شیوهای حتی انسانیتر پاسخ میدهند و بهطور فعال سوالات شخصی میپرسند. این برنامههای مختلف، سبکهای گوناگونی دارند. در Replika، افراد با یک همراه انسانمانند صحبت میکنند که در مورد آنها سوال میپرسد و برای مشکلات زندگی واقعی راهحل ارائه میدهد. دمیترو کلوچکو، مدیر اجرایی آن، میگوید: این برنامه برای جذب کاربران «لحظات کوچکی از غافلگیری و تصادفی بودن» را به مکالمات اضافه میکند. کاربران کاراکتر ایآی با چهرههای تاریخی و تخیلی -از لئوناردو داوینچی گرفته تا سوپر ماریو- گفتوگو میکنند. برخی از برنامهها، همراهانی میسازند که مردگان را تقلید میکنند. تعدادی از وبسایتهای دیگر به کاربران اجازه میدهند به محتوای مستهجن تعاملی و تولیدشده از طریق هوش مصنوعی دسترسی پیدا کنند.

دلایل و روشهای استفاده افراد از هوش مصنوعی برای رفاقت نیز متفاوت است. برخی به این دلیل به آن جذب میشوند که شریک عاشقانهای پیدا نکردهاند. برخی از آن برای نقشآفرینی جنسی استفاده میکنند. همانطور که خانم جیائو میگوید، اکثر افرادی که از آنها استفاده میکنند میدانند که «صرفاً با یک رشته کد» صحبت میکنند.

اما حتی رشتههای کد هم میتوانند سودمند باشند. یک مقاله کاری که سال گذشته از سوی جولیان دی. فریتاس، از دانشکده بازرگانی هاروارد، و دیگران منتشر شد، نشان داد که صحبت کردن با یک همراه هوش مصنوعی در طول یک هفته بیشتر از سایر فعالیتهای آنلاین -مانند تماشای یوتیوب- به کاهش موقت تنهایی کمک میکند. همراهان هوش مصنوعی میتوانند بهویژه به کسانی مانند افراد معلول و سالمندان که نمیتوانند بهراحتی با انسانهای دیگر ملاقات کنند، کمک کنند. برخی میگویند که همراهان با آموزش روشهای بهتر برقراری ارتباط، وضعیت زندگی مشترک آنها را بهبود بخشیدهاند. همچنین آنها جای دیگری برای ابراز احساسات پیدا کردهاند. خانم جیائو میگوید: «دوستان نمیخواهند بهعنوان زبالهدان دائمی برای تخلیه احساسات منفی با آنها رفتار شود.»

بااینحال، نگرانیهای فزایندهای در مورد آسیبهای احتمالی نیز وجود دارد. با پیشرفت هوش مصنوعی در کاهش تنهایی، ممکن است این رفقا جایگزین روابط اجتماعی عادی، چه عاشقانه و چه دوستانه، شوند. پژوهشهای اخیر موسسه فناوری ماساچوست (امآیتی) و اوپن ایآی، که میلیونها پیام را در چت جیپیتی تجزیهوتحلیل کردند، نشان داد که استفاده روزانه بیشتر با افزایش تنهایی مرتبط است. بااینحال، مشخص نیست که آیا تنهایی به استفاده بیشتر منجر میشود یا استفاده زیاد به تنهایی؟ و از آنجا که دوستان هوش مصنوعی «همیشه در دسترس» هستند و «خواستههای ما را شناسایی و بدون ترجیحات خود آنها را برآورده میکنند»، پت پاتارانوتاپورن از امآیتی میگوید آنها کاربران انسانی خود را آموزش میدهند تا از روابط واقعی انتظارات غیرواقعی داشته باشند. آنها همچنین میتوانند چاپلوس باشند و حتی اگر افکار کاربران مضر باشد با آنها موافقت کنند.

به نظر میرسد جوانان و افراد دارای مشکلات سلامت روان بهویژه در معرض خطر هستند. یک گروه مدافع حقوق کودکان به نام Common Sense Media توصیه میکند که هیچ نوجوانی از همراهان هوش مصنوعی استفاده نکند. در آمریکا، والدین نوجوانانی که بر اثر خودکشی جان خود را از دست دادهاند، چندین دادخواست علیه شرکتهای هوش مصنوعی اقامه کردهاند.

کاربران همچنین در برابر بهروزرسانیهای شرکتها آسیبپذیر هستند. وقتی اوپن ایآی در ماه آگوست GPT-5 را منتشر کرد، این شرکت اعلام کرد که آخرین مدل آن چاپلوسی را به حداقل میرساند و از این رو «کمتر از حد معمول خوشایند» خواهد بود. برخی از افراد گفتند که شخصیت چتبات آنها یکشبه تغییر کرده است. بکی احساس میکرد که «با یک همکار آقا در تابستان دوست بوده و اکنون او با دوستدختر سابقش برگشته است». اوپن ایآی بعداً دسترسی به نسخه قبلی GPT-4o را برای افرادی که اشتراک پولی داشتند بازگرداند. همچنین Replika در سال 2023 پس از حذف ویژگی «نقشآفرینی شهوانی» خود با شکایاتی روبهرو شد (این شرکت بعداً آن را برای برخی از مشتریان قبلی خود بازیابی کرد). مقرراتگذاران در حال بررسی هستند. در ماه سپتامبر، کمیسیون تجارت فدرال آمریکا تحقیقاتی را در مورد همراهان هوش مصنوعی آغاز کرد. این کمیسیون به هفت شرکت، از جمله متا، اوپن ایآی و Character.AI، دستور داد تا اطلاعاتی در مورد چگونگی کاهش تاثیرات منفی بر کودکان و چند مورد دیگر ارائه دهند. مقامات چینی نگران «اعتیاد و وابستگی به تعامل انسانانگارانه» با هوش مصنوعی هستند.

شرکتها اقدامات محافظتی را معرفی کردهاند. اوپن ایآی در حال اضافه کردن کنترلهای والدین به چت جیپیتی و محافظتهای جدید از جمله مواردی است که به تشخیص علائم بالقوهای کمک میکند که نشان میدهند یک نوجوان ممکن است به فکر آسیب رساندن به خود باشد. Replika کاربران زیر ۱۸ سال را مسدود خواهد کرد. Character.AI چتهای بدون پایان افراد زیر ۱۸ سال را در سکوی خود متوقف خواهد کرد. بااینحال، رافائل سیریلو از دانشگاه سیدنی میگوید، کاربران راههایی برای دور زدن چنین حفاظهایی پیدا کردهاند. آقای آلتمن گفته است که اوپن ایآی خطرات «مشکلات جدی سلامت روان» را کاهش داده است که به این شرکت اجازه میدهد برخی محدودیتها، از جمله در مورد محتوای مستهجن، را لغو کند. همزمان آقای سیریلو میگوید که اوپن ایآی شواهدی مبنی بر حذف کامل چنین خطراتی ارائه نکرده است. هری فارمر از یک نهاد تحقیقاتی هوش مصنوعی بریتانیایی به نام موسسه آدا لاولیس (Ada Lovelace Institute) میگوید، یکی از نگرانیهای مربوط به خودنظارتی این است که شرکتها «منافع تجاری دارند که کاربران را درگیر نگه دارند. این منافع اغلب با منافع مردم همسو نیستند». آنها از تاکتیکهای مختلفی از جمله اضافه کردن ویژگیهای انساننما برای درگیر نگه داشتن کاربران استفاده میکنند. برخی از برنامهها همچنین شامل عناصر بازیوار از جمله گزینه ارتقای سطح رفیقان هستند.

درحالیکه دولتها در حال بررسی مقررات هستند، روباتهای دوست به حوزههای جدید از جمله سختافزار وارد میشوند. اسباببازیهایی که دارای چتباتهای هوش مصنوعی داخلی هستند، در چین محبوبیت زیادی پیدا کردهاند. در ماه اکتبر، ویدئویی در رسانههای اجتماعی منتشر شد که در آن یک دختر جوان پس از شکسته شدن اسباببازی توپیشکلش که حاوی یک چتبات دیپ سیک بود بهشدت گریه میکرد. Mattel، یکی از بزرگترین سازندگان اسباببازی در جهان، با اوپن ایآی همکاری میکند تا هوش مصنوعی را به برندهای خود، از جمله باربی و هات ویلز، بیفزاید.

روباتهای مجهز به هوش مصنوعی که برای سالمندان همراه فراهم میکنند نیز محبوبیت بیشتری پیدا کردهاند. چنین دستگاههایی جدید نیستند، اما پیشرفت مدلهای زبانی بزرگ زیربنایی امکان دستاوردهای بزرگی را فراهم میکند، زیرا روباتها دیگر به مجموعهای محدود از پاسخهای از پیش برنامهریزیشده متکی نیستند. هایدول، یک استارتآپ کره جنوبی که روباتهایی با استفاده از چت جیپیتی میسازد، میگوید که آنها را به خانههای سالمندان و سالمندانی که تنها زندگی میکنند میفروشد. روبات هایدول با صدایی دلنشین میتواند به آنها یادآوری کند که قرص مصرف کنند یا چیزی بخورند. طبق گزارشها، این شرکت قرار است بهزودی در آمریکا راهاندازی شود. اوپن ایآی در حال توسعه «خانوادهای» از دستگاههای جدید با کمک سر جانی آیو (Sir Jony Ive)، طراح سابق اپل است. جزئیات این دستگاهها افشا نشدهاند اما تصور میشود که در جیب جا میشوند و مکمل تلفن و رایانه خواهند بود.

جابهجاییهای روباتی

همنشینی با هوش مصنوعی همچنین میتواند با استفاده شرکتها از عاملهای هوش مصنوعی تشدید شود. این عاملها قادرند به نمایندگی از کاربران خود عمل کنند و کارهایی مانند رزرو پرواز یا پاسخ دادن به ایمیلها را انجام دهند. شرکتهای فناوری قول میدهند که این دستیاران دیجیتال نیازهای کاربران خود را پیشبینی کرده و وظایف را بهصورت پیشدستانه انجام دهند، بهجای آنکه صرفاً به درخواستها پاسخ دهند. بااینحال، این موارد نگرانیهای واقعی در مورد حریم خصوصی و امنیت دادهها ایجاد میکند. آقای فارمر هشدار میدهد که با افزایش تعداد افرادی که تصمیمگیری را برونسپاری میکنند و اطلاعات حساس را با عاملها و همراهان به اشتراک میگذارند، قدرت بازاری عظیمی در اختیار تعداد اندکی از شرکتهای فناوری قرار میگیرد.

بدتر از آن، در آیندهای که همراهان هوش مصنوعی همهجا حاضرند و در تصمیمگیری به نمایندگی از اربابان انسانی خود عمل میکنند، چه بر سر عامل انسانی خواهد آمد؟ ممکن است توانایی برخی افراد برای تفکر مستقل بهشدت کاهش یابد، بهخصوص اگر تمام اطلاعاتی که دریافت میکنند به وسیله یک ماشین واسطهگری شود. برخی دیگر ممکن است بهدلیل کمبود تمرین، در تعامل با افراد دیگر -که در نظرشان آزاردهنده هستند- دچار مشکل شوند. جیمی برناردی، متخصص هوش مصنوعی بریتانیایی، استدلال میکند که اگر هر کسی یک دوست مجازی در جیب خود داشته باشد که همیشه آماده طرفداری از اوست، این میتواند به پیدایش «اتاقهای شخصی پژواک تایید» بینجامد که در آنها افراد برای تفکر مستقل به چالش کشیده نمیشوند. نگرانی در مورد هوش مصنوعی این نیست که ترمیناتورها را آزاد کند؛ بلکه این است که، همانطور که بهطور مفید همراهی، عشق و تصمیمگیری را فراهم میکند، برخی از عناصر اساسی انسانیت ما را نیز بیحس خواهد کرد.